Co jsou to deepfakes? Jak mohou falešná média poháněná umělou inteligencí pokřivit naše vnímání reality?

- Co je to deepfake?

- Jak vznikají deepfakes?

- Jak se deepfakes používají?

- Jak odhalit deepfake

- Boj proti deepfakes pomocí technologií

- Deepfakes používají umělou inteligenci k nahrazení podoby jedné osoby jinou ve videu nebo zvuku.

- Existují obavy, že deepfakes mohou být použity k vytváření falešných zpráv a zavádějících videí.

- Deepfakes můžete odhalit zpětným vyhledáváním obrázků nebo zkoumáním toho, kdo je zveřejnil.

Počítače se stále více zdokonalují v simulaci reality. Média vytvářená umělou inteligencí (AI) se dostávají na titulní stránky novin – zejména videa, která mají za úkol někoho napodobit, aby to vypadalo, že říká nebo dělá něco, co nedělá.

Jeden streamer na Twitchi byl přistižen na webové stránce známé tím, že vytvářel pornografii svých vrstevníků generovanou umělou inteligencí. Skupina newyorských studentů natočila video, na kterém jejich ředitel říká rasistické poznámky a vyhrožuje studentům. Ve Venezuele se generovaná videa používají k šíření politické propagandy.

Ve všech třech případech bylo video generované umělou inteligencí vytvořeno s cílem přesvědčit vás, že někdo udělal něco, co ve skutečnosti nikdy neudělal. Pro tento druh obsahu existuje slovo: Deepfakes.

Co je to deepfake?

Deepfakes využívají umělou inteligenci k vytváření zcela nových videí nebo zvuků s cílem zobrazit něco, co se ve skutečnosti nestalo.

Termín „deepfake“ pochází od základní technologie – algoritmů hlubokého učení – které se učí řešit problémy s velkými soubory dat a mohou být použity k vytváření falešného obsahu skutečných lidí.

„Deepfake by byl záznam, který je vytvořen počítačem, který byl vycvičen na základě nespočtu existujících snímků,“ řekla Cristina Lópezová, vedoucí analytička společnosti Graphika, která se zabývá výzkumem toku informací v digitálních sítích.

Deepfakes nejsou jen tak ledajaké falešné nebo zavádějící snímky. Papež v huňaté bundě vygenerovaný umělou inteligencí nebo falešné scény zatčení Donalda Trumpa, které se šířily krátce před jeho obviněním, jsou sice vygenerované umělou inteligencí, ale nejsou to deepfakes. To, co odlišuje deepfake, je prvek lidského vstupu.

Pokud jde o deepfakes, uživatel může až na samém konci procesu generování rozhodnout, zda to, co bylo vytvořeno, je to, co chce, nebo ne; kromě přizpůsobení tréninkových dat a dodatečného vyjádření „ano“ nebo „ne“ k tomu, co počítač vygeneruje, nemá možnost ovlivnit, jak se počítač rozhodne.

Jak vznikají deepfakes?

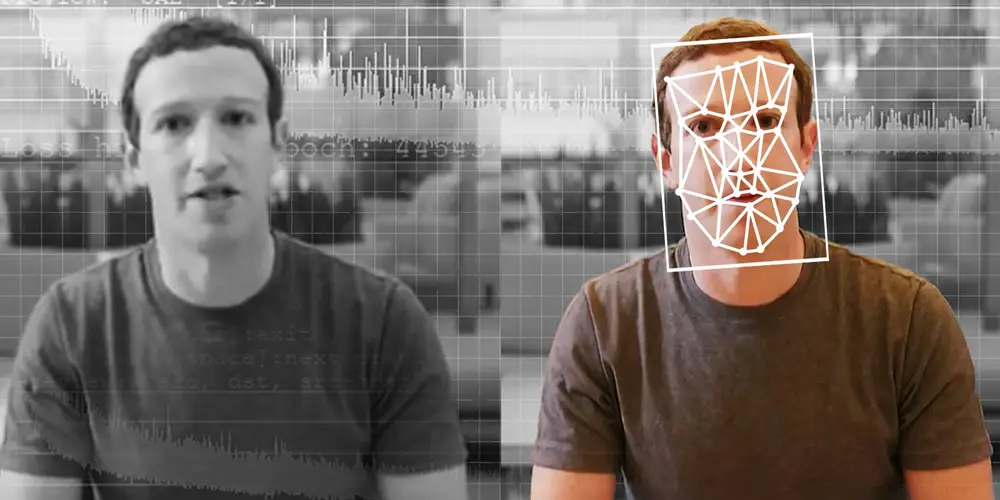

Existuje několik metod vytváření deepfakes, ale nejčastěji se používají hluboké neuronové sítě, které využívají techniku výměny tváří. Nejprve potřebujete cílové video, které použijete jako základ deepfake, a poté sbírku videoklipů osoby, kterou chcete do cílového videa vložit.

Videa mohou být zcela nesouvisející; cílem může být například klip z hollywoodského filmu a videa osoby, kterou chcete do filmu vložit, mohou být náhodné klipy stažené z YouTube.

Program odhadne, jak daná osoba vypadá z více úhlů a podmínek, a poté ji přiřadí k jiné osobě v cílovém videu tak, že najde společné rysy.

Do mixu se přidává další typ strojového učení, známý jako generativní adverzní sítě (GAN), který v rámci několika kol odhaluje a vylepšuje případné nedostatky v deepfake, čímž znesnadňuje jejich dekódování detektory deepfake.

Ačkoli je tento proces složitý, software je poměrně přístupný. Několik aplikací usnadňuje generování deepfake i začátečníkům – například čínská aplikace Zao, DeepFace Lab, FakeApp a Face Swap – a velké množství deepfake softwaru lze nalézt na GitHubu, komunitě vývojářů open source.

Jak se deepfakes používají?

Technologie Deepfake se v minulosti používala k nezákonným účelům, včetně vytváření nepovolené pornografie.

V roce 2017 vytvořil uživatel redditu s přezdívkou „deepfakes“ fórum pro porno, na kterém vystupovali herci s vyměněnými obličeji. Od té doby se pornografie (zejména pornografie z pomsty) opakovaně dostala do zpráv a vážně poškodila pověst celebrit a významných osobností. Podle zprávy společnosti Deeptrace tvořila pornografie 96 % deepfake videí nalezených na internetu v roce 2019.

Deepfake videa byla použita také v politice. V roce 2018 například belgická politická strana zveřejnila video Donalda Trumpa, který ve svém projevu vyzval Belgii, aby odstoupila od Pařížské dohody o klimatu. Trump však tento projev nikdy nepronesl – jednalo se o deepfake. Nebylo to první použití deepfake k vytvoření zavádějících videí a technicky zdatní političtí experti se připravují na budoucí vlnu falešných zpráv, které budou obsahovat přesvědčivě realistické deepfake.

Novináři, skupiny pro lidská práva a mediální technologové však pro tuto technologii našli i pozitivní využití. Například dokumentární film HBO „Vítejte v Čečensku“ z roku 2020 použil technologii deepfake k ukrytí identity ruských LGBTQ uprchlíků, jejichž životy byly ohroženy, a zároveň vyprávěl jejich příběhy.

Organizace WITNESS, která se zaměřuje na využívání médií k obraně lidských práv, vyjádřila optimismus ohledně takto využívané technologie a zároveň si uvědomuje digitální hrozby.

„Součástí naší práce je skutečně zkoumání pozitivního využití této technologie, od ochrany lidí, jako jsou aktivisté na videu, přes advokační přístupy až po politickou satiru,“ uvedla shirin anlen, mediální technologka organizace WITNESS.

Pro anlen a WITNESS není tato technologie něčím, čeho by se měli úplně bát. Naopak, měli bychom ji vnímat jako nástroj. „Navazuje na dlouhodobý vztah, který máme s audiovizuálními prostředky. S audiem jsme již manipulovali. Už jsme různými způsoby manipulovali s vizuálními efekty,“ řekl Anlen.

Odborníci jako anlen a López se domnívají, že nejlepším přístupem veřejnosti k deepfakes je nepropadat panice, ale informovat se o této technologii a jejích možnostech.

Jak odhalit deepfake

Existuje několik indikátorů, které prozrazují deepfakes:

- Zdají se vám detaily rozmazané nebo nejasné? Hledejte problémy s kůží nebo vlasy nebo obličeje, které se zdají být rozmazanější než prostředí, ve kterém se nacházejí. Zaostření může vypadat nepřirozeně měkce.

- Vypadá osvětlení nepřirozeně? Algoritmy deepfake často zachovávají osvětlení klipů, které byly použity jako modely pro falešné video, což se špatně shoduje s osvětlením v cílovém videu.

- Nesouhlasí slova nebo zvuky s vizuálními efekty? Může se zdát, že zvuk neodpovídá osobě, zejména pokud bylo video podvrženo, ale původní zvuk nebyl tak pečlivě zmanipulován.

- Působí zdroj důvěryhodně? Jednou z technik, kterou novináři a výzkumníci často používají k ověření skutečného zdroje obrazu a kterou můžete provést právě teď, je zpětné vyhledávání obrazu. Měli byste také zkontrolovat, kdo obrázek zveřejnil, kde byl zveřejněn a zda to dává smysl.

Boj proti deepfakes pomocí technologie

Se zdokonalováním technologií bude pravděpodobně stále těžší odhalit rozdíly mezi skutečným a falešným obsahem. Z tohoto důvodu se odborníci jako anlen domnívají, že by odhalování deepfakes ve volné přírodě nemělo být na jednotlivcích.

„Zodpovědnost by měla být na vývojářích, na tvůrcích nástrojů, na technologických společnostech, aby vyvinuli neviditelné vodoznaky a signalizovali, co je zdrojem tohoto obrázku,“ řekl anlen. A řada začínajících společností vyvíjí metody pro odhalování deepfakes.

Například společnost Sensity vyvinula detekční platformu, která se podobá antiviru pro deepfakes a která uživatele upozorňuje prostřednictvím e-mailu, když sledují něco, co nese zřetelné otisky médií vytvořených umělou inteligencí. Sensity využívá stejné procesy hlubokého učení, které se používají k vytváření falešných videí.

Operace Minerva má k odhalování deepfakes přímočařejší přístup. Algoritmus této společnosti porovnává potenciální deepfakes se známými videi, která již byla „digitálně otisknuta“. Dokáže například odhalit příklady pornografie z pomsty tím, že rozpozná, že deepfake video je jednoduše upravenou verzí existujícího videa, které již Operace Minerva katalogizovala.

Navzdory těmto pokrokům Nasir Memon, profesor počítačové vědy a inženýrství na Newyorské univerzitě, uvedl, že zatím nebyly vyvinuty žádné snahy o boj proti deepfakes ve velkém měřítku a že jakékoli řešení, které přijde, nebude všelékem, který by zabránil šíření škodlivých deepfakes.

„Myslím, že řešení celkově není založeno na technologii, ale spíše na vzdělávání, informovanosti, správných obchodních modelech, pobídkách, politikách a zákonech,“ řekl Memon.

Poznámka: Několik států přijalo nebo se pokusilo přijmout právní předpisy, které zakazují používání deepfakes v konkrétních případech, například pro pornografii nebo politiku, včetně Kalifornie, New Yorku a Virginie.

Rostoucím problémem je používání deepfakes v živém prostředí k maskování identity v daném okamžiku, například během telefonního hovoru nebo schůzky na Zoomu. Podle Memona může hrozba, že někdo použije falešnou identitu, vzniknout v jakémkoli počtu situací, od pracovních pohovorů přes zkoušky na dálku na vysoké škole až po žádosti o vízum. Dokonce i reportéři deníku Insider se museli vypořádat s podvodníky, které umělá inteligence oslovila jako své zdroje.

„Problém s odhalováním spočívá v tom, že břemeno je na obránci,“ řekl Memon. „Musím analyzovat každý jednotlivý snímek všemi možnými způsoby. Ale v oblasti bezpečnosti to chcete dělat opačně.“ Ideální by bylo vyvinout technologii, která by detekovala i tyto typy živých deepfakes.

Přesto Memon neočekává, že by tento druh přístupu znamenal konec otázky deepfake.

„Nic tento problém zcela nevyřeší. Autenticita se vždy musí testovat ve společnosti,“ řekl. „Nedělejte ukvapené závěry, když teď uvidíte nějaký obrázek. Podívejte se na zdroj. Počkejte, až budete mít potvrzující důkazy ze spolehlivých zdrojů.“

Mohlo by Vás zajímat:

Zákonodárci EU schválili první komplexní rámec pro regulaci kryptoměn na světě

TikTok sdílí klíčové tipy pro spolupráci s tvůrci pro firmy v novém průvodci

Twitter Inc. Fúze do společnosti X Corp. V rámci dalšího vývoje aplikace

3 thoughts on “Co jsou to deepfakes? Jak mohou falešná média poháněná umělou inteligencí pokřivit naše vnímání reality?”